- AI从此有了“照妖镜”:新数据库精准识别视觉偏见

- 资料来源:科学网

AI从此有了“照妖镜”:新数据库精准识别视觉偏见

来源:蝌蚪五线谱 2025-11-07

摘要:

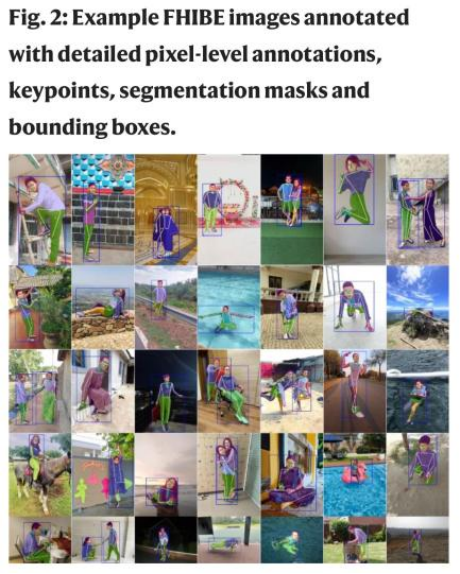

人工智能正迎来一面更公正的“镜子”。研究人员近日构建了一个包含超过1万张人类图像的数据库,为评估AI视觉系统中的偏见提供了全新工具。

这个名为FHIBE的数据库与众不同之处在于其严格的伦理标准:所有图像均获得参与者明确知情同意,涵盖81个国家和地区的1981名普通人,并详细标注了年龄、血统、肤色等特征。相比以往常从网络随意抓取的数据,这个数据库更像是一面精心打磨的镜子,能更真实地反映人类的多样性。

研究团队将FHIBE与27个现有数据集比较后发现,新数据库在多样性和伦理标准上都更为出色,特别关注了传统上容易被忽略的人群。这意味着,用它来测试AI模型,能够发现更多隐藏的偏见问题——比如对某些人群识别不准,或强化刻板印象等。

尽管构建这样的数据库充满挑战,但这项研究为开发更可信、更公平的人工智能迈出了坚实的一步。

本项研究的相关图像数据(图片来自论文)。施普林格·自然供图